Depuis plusieurs mois, lâusage de la reconnaissance faciale à des fins sécuritaires et/ou sanitaires, et les réserves quâil suscite, tant des citoyens que des institutions nationales ou européennes, ne cesse dâêtre traité dans nos colonnes. Si la Chine avait jeté un pavé dans la mare en 2014 avec lâinstauration de son « crédit social » â en témoigne la horde de sujets à charge diffusés et publiés à lâépoque par les mass media â, lâapathie médiatique semble aujourdâhui prévaloir dès que lâon évoque une possible application de cette technologie sur un territoire européen. Certes, on est encore loin de la résignation collective dépeinte dans Black Mirror â en Europe tout du moins â, mais quand on voit lâintérêt grandissant des pouvoirs public pour une telle technologie, on ne peut que redouter lâavenir. Dâautant plus que ce qui est vrai dans nos contrées lâest davantage de lâautre côté de lâAtlantique ou de lâOcéan Indien. De quoi donner ensuite donner des idées à tous les ayatollah du progrès technologique.

Une terre dâexpérimentation

Début septembre, la police australienne annonçait recourir à la reconnaissance faciale pour sâassurer du bon respect des mesures sanitaires par ses concitoyens. En lâoccurrence, ce sont les états de Nouvelles-Galles du Sud et Victoria â qui abrite notamment Sydney, Melbourne et donc plus de la moitié des 25 millions dâaustraliens â qui y ont recours pour sâassurer que leurs administrés restent bien isolés durant leur quarantaine. Le protocole mis en place impose aux australiens concernés de répondre à des contrôles inopinés en envoyant un selfie capturé depuis leur domicile. Si le logiciel, qui collecte également des données sur la localisation de ses utilisateurs, nâarrive pas à vérifier la « signature faciale » de la personne, la police est susceptible de passer à leur domicile pour de plus amples vérifications. Ces essais, réalisés sur la base du volontariat, sont basé sur une technologie développée depuis 2020 par une entreprise dénommée Genvis. La firme basée à Perth espère profiter de cet essai grandeur nature pour ensuite vendre leur solution à lâétranger.

Lâironie du sort est que cette information lourde de conséquences a été révélée quelques jours à peine après que les Nations Unies ont mis en garde sur les dangers de cette technologie en regard des droits de lâhomme. Michelle Bachelet, la haute-commissaire des Nation unies aux droits de lâhomme, a déclaré le mercredi 15 septembre dernier que la reconnaissance faciale présente « un risque grave pour les droits de l’homme », jusqu’à ce que « des garanties adéquates soient mises en place ». Avant de poursuivre : « L’intelligence artificielle peut être une force pour le bien, aidant les sociétés à surmonter certains des grands défis de notre époque, a-t-elle déclaré. Mais les technologies de l’IA peuvent avoir des effets négatifs, voire catastrophiques, si elles sont utilisées sans tenir suffisamment compte de la manière dont elles affectent les droits humains des personnes ».

Des opinions divergentes

Au vu de ces révélations, Kristin Butcher, directrice générale de Gengis a déclaré sobrement que « nous ne pouvons pas instaurer une quarantaine obligatoire sans opérer de vérifications si lâon souhaite que les populations ne courent aucuns dangers. Dâautre part, il est impossible de vérifier systématiquement chaque adresse sur un territoire national donné, ainsi lâusage de la technologie sâimpose ». Loin de partager sa vision de la situation, de nombreux avocats des droits humains ont déjà mis en garde sur lâinexactitude de la reconnaissance faciale, dâune part, et sur le risque dâune utilisation des données récoltés par les autorités à des fins autres que simplement sanitaire, dâautre part. Interrogé sur le sujet par dâEuronews, Toby Walsh, professeur dâIntelligence Artificielle à lâuniversité de Nouvelle-Galles du Sud, concluait : « Cet usage spécifique me dérange, mais je suis avant tout inquiet par le fait que celui-ci symbolise la montée en puissance de cette technologie dans nos vies. Même si elle fonctionne convenablement, elle valide lâidée que lâapplication de la reconnaissance faciale est légitime. Jusquâoù irons-nous ? ».

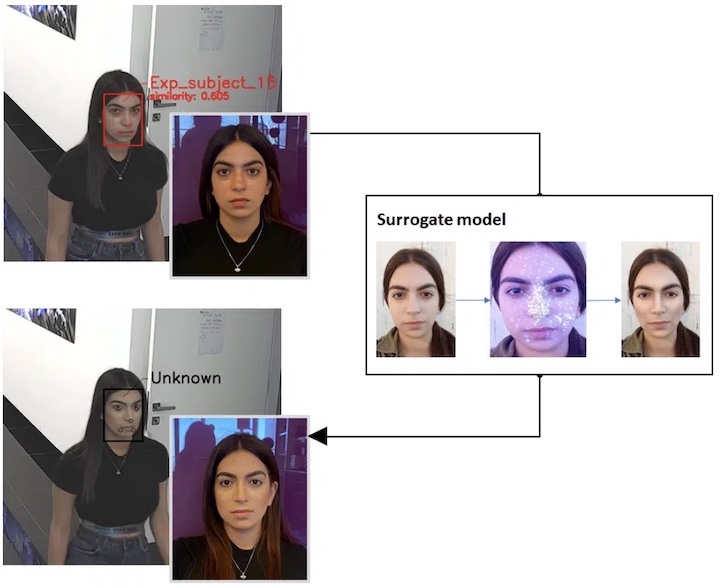

En attendant le dénouement de cet effroyable scenario, nous vous relayons les résultats â encourageants â dâune étude menée par des chercheurs de lâUniversité Ben-Gurion du Néguev dont lâobjectif était dâélaborer des moyens pour contourner ces logiciels de reconnaissance faciale. Après avoir appliqué du maquillage numériquement puis physiquement sur une vingtaine de personnes, les scientifiques ont réussi à tromper les logiciels dans 98% des cas. Le processus sâest fait en deux étapes : le maquillage numérique a été appliqué en fonction dâune carte thermique ciblant les régions les plus identifiables du visage. Un maquilleur a ensuite reproduit le maquillage numérique sur les participants, en sâassurant que le résultat soit le plus naturel possible. Dans les expériences numériques, les taux de réussites sâélevaient à 100 %. Concernant les expériences physiques, les participants ont été identifiés dans 47 % des cas, lorsquâils ne portaient pas de maquillage, et dans 33,7 % des cas quand ils étaient maquillés de façon aléatoire. Cependant, le système nâa identifié les participants que dans 1,2 % des cas lorsque les chercheurs ont appliqué le maquillage sur les parties hautement identifiables du visage. Concernant le maquillage utilisé, aucune crainte à avoir : lâobjectif nâest pas de vous grimer comme le Joker de Todd Philips dès que vous voudrez passer un portique de sécurité. Les chercheurs ont eu recours à des palettes de couleur neutres pour obtenir une apparence naturelle. En bref, une étude qui rassurera â quelque peu â les défenseurs des droits de lâhomme du monde⦠et les actionnaires de Séphora.

source : www.influencia.net